인공지능 규제

-

EU AI 법 3차 행동 강령(Code of Practice)과 시사점

AI 리스크 관리, AI 모델 정책, AI 거버넌스, AI 법률, AI 법률 초안, AI 법안, AI 법적 책임, AI 보고 의무, AI 규제 가이드라인, AI 규제 초안, AI 투명성, AI 학습 데이터, AI 행동강령, AI 윤리, AI 저작권, AI와 저작권, ChatGPT 규제, Code of Practice, EU AI Act, EU AI 법, 대규모 언어모델, 범용 인공지능, General-Purpose AI, GPAI, GPT, 시스템적 위험, 유럽 AI 정책, 인공지능 규제, 창작자 반발, 창작자 권리 보호, LLM, robots.txt, TDM 옵트아웃

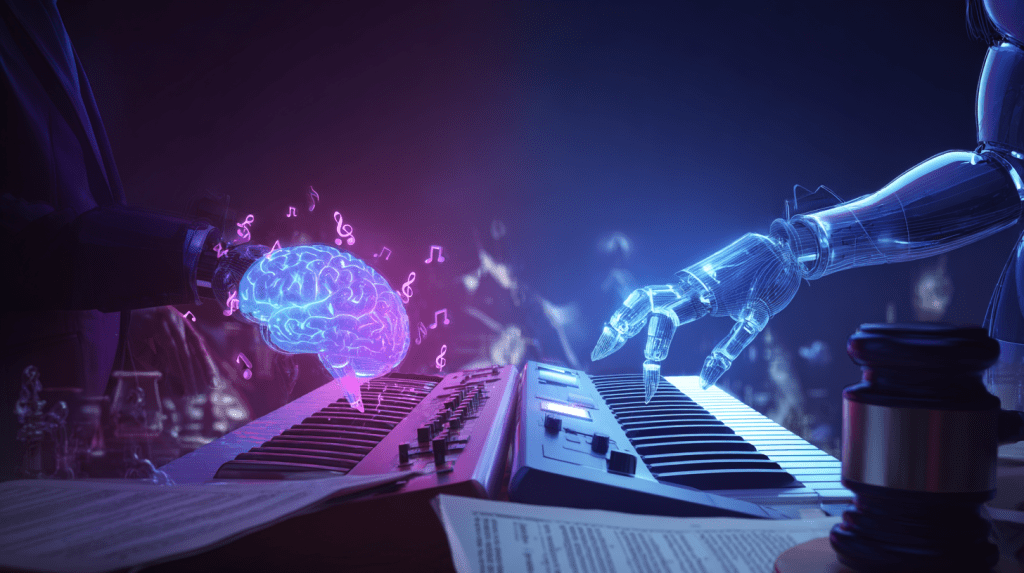

EU AI 법은 2024년 유럽연합에서 채택된 인공지능 규제로, 안전성과 인권 보호를 목표로 합니다. 최근 공개된 GPAI에 대한 3차 행동 강령 초안은 투명성, 저작권 준수, 위험 관리, 사용자 권리 보호를 포함하지만, 창작자 권리 보호에 대한 우려가 제기되고 있습니다.

-

AI 리스크 관리를 위해 국제사회와 국내에서 다양한 논의와 법제화가 진행 중이며, 시민 참여가 필요함. 특히 AI 기술이 삶의 모든 영역에 적용될 것이므로 이에 대한 사회적 준비가 시급함.

-

![[특별기고] 딥페이크 성범죄](https://greengeek.blog/wp-content/uploads/2024/08/zt9tpixmswmd-7-r6gycba.png?w=1024)

안녕하세요. 저는 기술과 페미니즘을 엮는 테크-페미 활동가 갱입니다. 이번 ICT 뉴스레터를 통해 최근 뜨겁게 불거지고 있는 딥페이크 성범죄에 대해 알기 쉽게 설명하고, 또 당장 할 수 있는 행동 하나를 소개하려 합니다. 최근에 이슈가 되고 있기는 하지만, 딥페이크 성범죄에 대한 우려는 수년 전부터 제기되어 왔습니다. 여기에는 프로필 사진 등을 손쉽게 캡처할 수 있도록 방치한 플랫폼의 책임도…